דגש על אינפרנס, רַק נוזלי מלא וכרטיסים עתירי זיכרון — ניסיון להציב חלופה חסכונית לענן ה־AI

מה מציע שבב AI200 (זמינות מתוכננת: 2026)

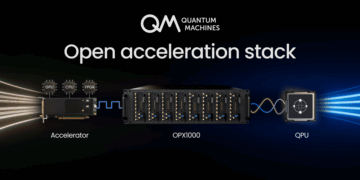

קוואלקום ממקמת את AI200 כ”סוס עבודה” לאינפרנס (הרצת מודלים) במרכזי נתונים. המערכת מגיעה גם כתצורת רַק שלם עם קירור נוזלי ישיר וצריכת חשמל בסדר גודל של 160 קילו־ואט לרַק. כל כרטיס מאיץ במערכת תומך בעד 768 ג׳יגה־בייט זיכרון — נפח גבוה שמאפשר להחזיק מודלים גדולים יותר בזיכרון מקומי ולהפחית גישות לאחסון חיצוני. השבב נשען על המאיץ העצבּי של קוואלקום (Hexagon) שהוכר בעבר מעולם המובייל, ועבר התאמה לעומסים של דאטה־סנטר. חיבוריות המערכת מאפשרת “לבנות לאט או בגדול”: גם כרטיסים בודדים לשרתים קיימים, וגם רַק שלם “מוכן לעבודה”.

מה מציע שבב AI250 (זמינות מתוכננת: 2027)

AI250 הוא הדור המתקדם יותר ומשמר את אותם עקרונות — אינפרנס, רַק נוזלי וכרטיסים עתירי־זיכרון — אך מוסיף אדריכלות זיכרון “קרוב למעבד” שמטרתה להגדיל רוחב פס ולהקטין זמני גישה בין החישוב לזיכרון. בפועל זה אמור לתרגם ליותר ביצועים לוואט במשימות כמו מענה לשאלות, סיכום טקסטים, עיבוד תמונה/וידאו ויישומי מולטימודל. גם כאן קוואלקום מדגישה מודולריות: לקוחות ענן גדולים יכולים “לערבב ולהתאים” — להזמין רַק שלם, או לקנות רק כרטיסים/רכיבים ולשלבם בתצורות קסטומיות.

הבדלים עיקריים בין AI200 ל-AI250

- לוח זמנים: AI200 קודם לשוק (2026), AI250 אחריו (2027).

- זיכרון וביצועים: לשניהם כרטיסים בנפחי זיכרון חריגים לטובת מודלים גדולים; AI250 מוסיף שכבת “זיכרון קרוב” לשיפור קצב ועקביות.

- קהל יעד: שניהם מכוונים בעיקר לאינפרנס בקנה־מידה גדול; AI250 נועד להוריד עוד יותר את עלות ההרצה לשאילתה (TCO) ולייעל עבודת מודלים כבדים.

התחרות מול אנבידיה (וגם AMD): מה הסיכוי של קוואלקום?

אנבידיה מחזיקה כיום בנתח עצום בשוק מאיצי ה-AI לדאטה־סנטר, בזכות ביצועים גבוהים, תשתית תוכנה ותיק אקו־סיסטם עשיר. קוואלקום לא מנסה “לנצח באימון המפלצות” (Training) — החלק שבו אנבידיה בולטת במיוחד — אלא תוקפת את שלב ההרצה שבו העלות, הצריכה החשמלית וצפיפות המחשוב הם הקריטיים למפעילי ענן. היתרונות שקוואלקום מבטיחה:

- עלות כוללת נמוכה יותר להיסק (פחות חשמל לרַק, יותר זיכרון לכרטיס → פחות תנועה לאחסון, יותר פניות לשנייה).

- מודולריות בתצורה: אפשר לקנות רַק שלם ו”לסגור עניין”, ואפשר לשלב כרטיסים במערכים קיימים — גישה שמתאימה ללקוחות היפר־סקייל שרוצים שליטה בעיצוב הרַק.

- התמקצעות במשימות אינפרנס נפוצות: במקום “להיות הכי מהיר בכל מבחן”, המיקוד הוא ביעילות לוואט ולדולר במשימות ה־LLM שהכי מריצים בפועל.

עם זאת, יש לקוואלקום גם אתגרי כניסה ברורים:

- תוכנה ואקו־סיסטם: אנבידיה נהנית מכלי פיתוח וספריות שמפתחים מכירים. כדי לזכות באמון, קוואלקום תצטרך תאימות רחבה למודלים/כלים, מעברי קוד קלים ותמיכה קהילתית.

- שקיפות טכנית: עד שלא ייחשפו נתוני ביצועים מלאים (מדדים מוסכמים, עומסי אמת, השוואות ל-NVL ול-MI של AMD), לקוחות ישמרו על זהירות.

- הוכחת פריסה רחבת־היקף: יש עניין מוקדם (כולל פרויקט פריסה אזורי גדול), אך השוק ירצה לראות ריצות ייצור אצל ענני ענק, זמינות ספקיות, ושירות לכל אורך מחזור החיים.

מה עדיין לא פורסם בפירוט (וצריך לעקוב)

מחירים מדויקים, נתוני הספק חישוב רשמיים בבנצ’מרקים סטנדרטיים, והיקף שילוב אצל ענני־על במערכי ייצור. אלו יכריעו אם ההבטחות ל־TCO נמוך יתורגמו לעסקאות רחבות.

אמפמ

כותרת: קוואלקום מציגה מאיצי AI לדאטה־סנטר: AI200 ב־2026 ו-AI250 ב־2027, עם רַק נוזלי וכרטיסים עתירי־זיכרון

כותרת משנה: המיקוד הוא באינפרנס וחיסכון בעלות — ניסיון להתמודד עם הדומיננטיות של אנבידיה באמצעות זיכרון גדול, קירור יעיל ומודולריות פריסה

תגים: קוואלקום, אנבידיה, AMD, דאטה־סנטר, אינפרנס, מאיצי בינה, קירור נוזלי, זיכרון, עלות כוללת, ענן

ביטוי מפתח: מאיצי אינפרנס של קוואלקום לדאטה־סנטר

נרדפים: מאיצי AI, תשתיות ענן ל־AI, רַק חכם, יעילות לוואט

SLUG: qualcomm-ai-inference-ai200-ai250-vs-nvidia-2026-2027