מרטין הורן, ארכיטקט מערכות AI ארגוניות ב־AMD, אמר בכנס ChipEx2026 כי שוק ההסקה הופך למרכז הכובד החדש של תשתיות הבינה המלאכותית, וכי ארגונים יחפשו יותר פתרונות מקומיים, זולים ומבוזרים להפעלת מודלים

מרטין הורן, חבר סגל בכיר ב־AMD וארכיטקט מערכות AI ארגוניות, הציג בכנס ChipEx2026 את האופן שבו החברה רואה את השינוי הבא בשוק תשתיות הבינה המלאכותית. לדבריו, בעוד שהשיח הציבורי והמקצועי התמקד בשנים האחרונות בעיקר באימון מודלים גדולים, בפועל מרכז הכובד מתחיל לעבור אל ההסקה, כלומר אל הפעלת המודלים בסביבות אמיתיות, אצל משתמשים וארגונים.

הורן תיאר את AMD כחברה שפעלה במשך שנים במתכונת רזה מאוד, כמעט כמו חברת הזנק גדולה, והצליחה בשנים האחרונות להגדיל משמעותית את נוכחותה בשוק השרתים. לדבריו, אחת הסיבות המרכזיות לכך היא אימוץ מוקדם של טכנולוגיית צ'יפלטים. במקום לייצר שבב גדול אחד, AMD שילבה כמה פרוסות סיליקון קטנות יותר במארז אחד. כך ניתן היה לשפר את התפוקה בייצור, להשתמש בטכנולוגיות הייצור המתקדמות ביותר רק ברכיבי החישוב הקריטיים, ולהשיג צפיפות גבוהה יותר של ליבות במעבד.

בהמשך הציג הורן את דור המעבדים הבא של החברה, Venice, שלדבריו צפוי לכלול עד 250 ליבות במארז יחיד, או 512 יחידות עיבוד גלויות למערכת ההפעלה כאשר מופעל SMT. לדבריו, צפיפות כזו עשויה לאפשר עד כ־20 אלף ליבות CPU בארון שרתים רגיל, בלי לשנות את מערכת הקירור.

אבל עיקר הרצאתו התמקד בבינה מלאכותית. הורן הבחין בין שני דפוסי פריסה שונים: אימון והסקה. האימון דומה יותר לעולם מחשוב העל. הוא מתבצע באצוות, מנצל אשכולות גדולים של מאיצים גרפיים, ודורש רשת פנימית צפופה ומהירה. ההסקה שונה לחלוטין. היא מבוזרת, תנודתית, תלויה בעומסים משתנים, ודורשת איזון עומסים בין מופעי שירות רבים של מודלים. לכן, לדבריו, הבחירה בגודל המאיץ ובתצורת המערכת אינה תמיד ברורה מראש, ולעיתים היא דורשת התאמה עדינה בין דרישות הזיכרון, ההקשר והביצועים של כל מודל.

הורן העריך כי עד 2030 תשתיות האימון ימשיכו לגדול, אך יהוו רק כ־30% מהאספקה החדשה של תשתיות AI, בעוד שההסקה תתפוס את רוב הגידול. בניגוד לאימון, שצפוי להתרכז במרכזי נתונים גדולים, ההסקה תתפרס במקומות רבים יותר: בענן, במתקני אירוח מנוהלים, בארגונים, בקצה הרשת ובמחשבים מקומיים.

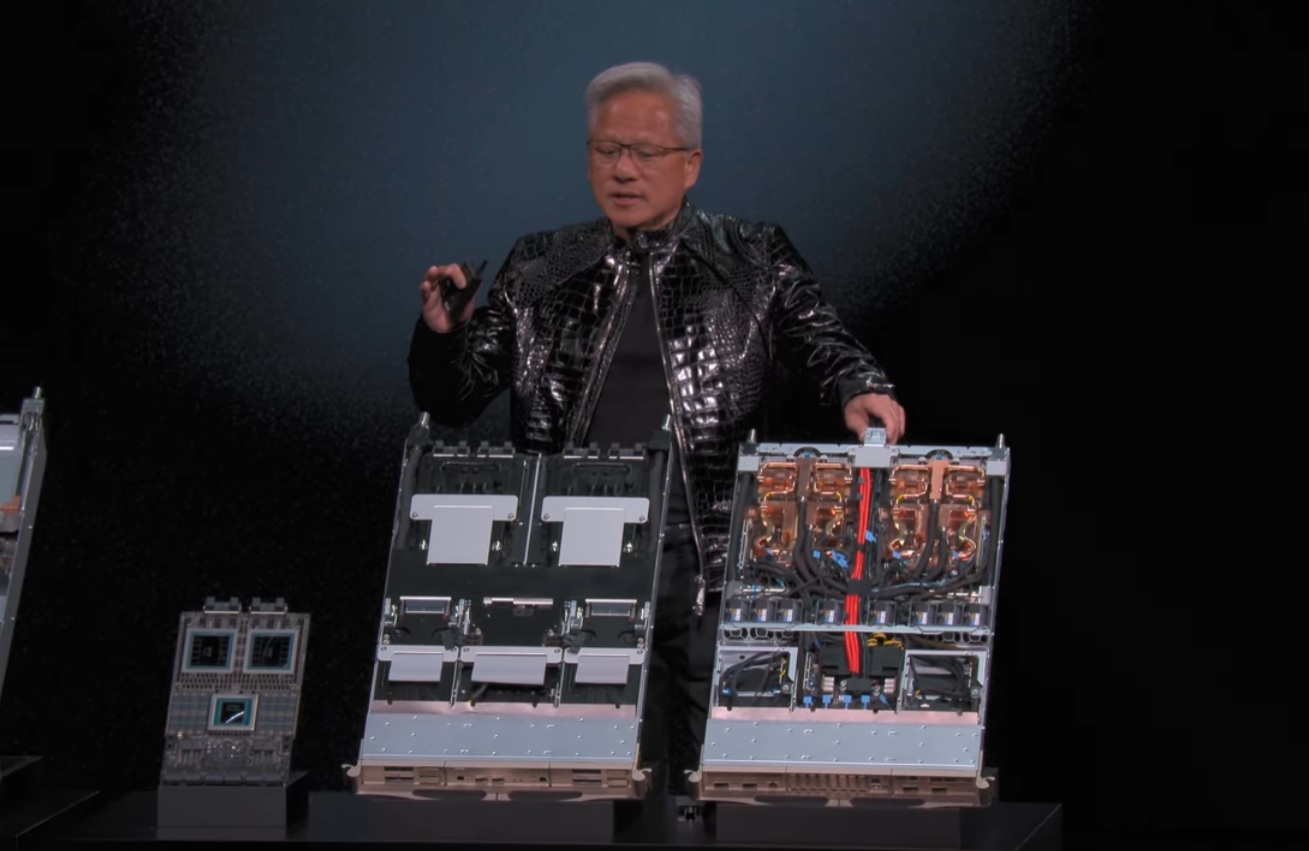

בהקשר זה הציג הורן את פורטפוליו ה־AI הרחב של AMD. בקצה אחד נמצאים פתרונות משובצים וטכנולוגיות FPGA שהגיעו עם רכישת Xilinx. בקצה אחר נמצאים מעבדי Ryzen Pro, שיכולים להריץ מודלים מקומיים במחשב אישי כאשר אין חיבור רשת או כאשר נדרש לשמור מידע רגיש בארגון. בנוסף הציג את משפחת Instinct, את כרטיס MI350P ואת מערכת Helios, המיועדת לפריסה בקנה מידה של ארון שלם.

לדבריו, יותר ארגונים צפויים להעדיף תשתיות AI בשליטה עצמית, לעיתים במתקני אירוח מנוהלים ולאו דווקא פיזית בתוך הארגון. הסיבות לכך הן עלות, שיהוי, פרטיות, מיקום הנתונים וריבונות דיגיטלית. הורן טען כי במקרים מסוימים עלות ההפעלה המקומית עשויה להיות נמוכה פי עשרה עד פי 15 מהפעלה בענן ציבורי.

בסיכום דבריו הדגיש הורן כי AMD רואה בבינה המלאכותית לא שוק אנכי נפרד, אלא שכבת תשתית שתשפיע על כל השווקים. לכן, לדבריו, אין פתרון AI אחד שמתאים לכולם. השוק ידרוש שילוב של CPU, GPU, מאיצים ייעודיים, מערכות ארגוניות, פתרונות קצה ותקני חומרה ותוכנה פתוחים.